はじめに

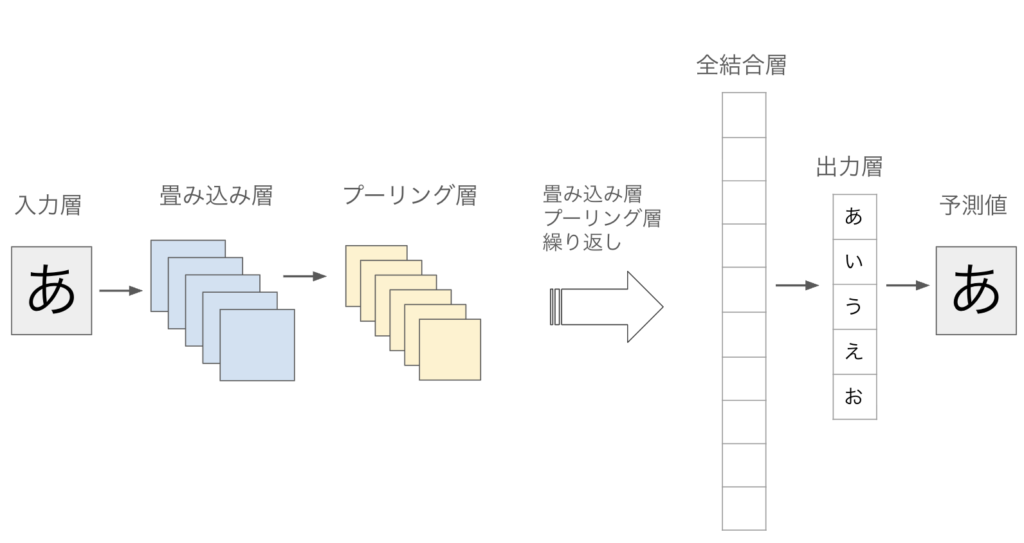

深層学習、特に畳み込みニューラルネットワーク(CNN)において、畳み込み層(Convolutional Layer)とプーリング層(Pooling Layer)は非常に重要な役割を果たす操作です。

今回は、畳み込み層とプーリング層の仕組みや効果について、実際のデータを見ながら解説していきます。

もしこれらについて理解が難しい場合は、経験豊富な方とマンツーマンで学習していくのもオススメです。

畳み込み層とプーリング層とは

畳み込み層とプーリング層とは、入力データの空間的な次元を削減する操作のことです。

畳み込み層で抽出された特徴マップに対してプーリング層が適用され、幾度か繰り返されながらデータのサイズを小さくし重要な情報を保持し学習します。

プーリングの目的

計算効率の向上: データサイズの縮小により、後続の層での計算量が大幅に削減されます。特に、大きな画像を扱う場合、この効果は顕著に現れます。

過学習の抑制: 物体が画像内で少し移動しても、同じような特徴表現が得られます。これにより、モデルの頑健性が向上します。

主要な畳み込み手法

畳み込み演算は、フィルタ(カーネル)を入力データ上でスライドさせながら、要素積の和を計算する手法です。

画像の特徴を抽出する最も基本的な操作で、エッジ検出や特徴抽出に使用されます。

例えば、2×2のフィルタで畳み込みを適用すると

入力: フィルタ: 出力:

[1, 2, 3] [1, 0] [6, 8]

[4, 5, 6] * [0, 1] → [12, 14]

[7, 8, 9]

計算過程:

左上: 1×1 + 2×0 + 4×0 + 5×1 = 6

右上: 2×1 + 3×0 + 5×0 + 6×1 = 8

左下: 4×1 + 5×0 + 7×0 + 8×1 = 12

右下: 5×1 + 6×0 + 8×0 + 9×1 = 14主要なプーリング手法

Max Pooling

Max Poolingは、指定されたウィンドウ内の最大値を取得する手法です。最も一般的に使用されるプーリング手法の一つで、重要な特徴を強調する効果があります。

例えば、2×2のウィンドウでmax poolingを適用すると

入力: 出力:

[1, 3] → [3]

[2, 1]

計算過程:

出力: MAX(1,3,2,1) = 3Average Pooling

Averaget Poolingは、ウィンドウ内の値の平均を取る手法です。ノイズの影響を軽減し、滑らかな特徴表現を生成します。

入力: 出力:

[1, 3] → [1.75]

[2, 1]

計算過程:

出力: (1+3+2+1)/4 = 1.75まとめ

畳み込みとプーリングは深層学習における基本的かつ重要な操作です。計算効率の向上、位置不変性の獲得、過学習の抑制など、多くのメリットを提供します。

ただし、情報の損失というデメリットも存在するため、タスクの性質に応じて適切に選択することが重要です。

CNNを学ぶのにオススメの方法

書籍:画像認識プログラミングレシピ

こちらは様々な画像認識のプログラムが記載されており、実際の実務に活用することが可能です。

スクール:現役データサイエンティストに教えてもらう

CNNは画像分析でよく用いられ、高精度で予測することができます。一方で正しい理解をしなけれ改善手法を試していくことも難しいです。

スクールなどに入り、アドバイスしてもらいながらしっかり理解して進めるのも良いと思います。

コメント