はじめに

ディープラーニングを学び始めると、必ず使用する概念の一つが「エポック数(Epochs)」です。この値の設定は、モデルの性能を大きく左右する重要な要素です。

本記事では、エポック数の基本概念から最適な設定方法まで、実践的な観点から詳しく解説します。

この領域は複雑で理解が難しいですが、これらについて理解が難しい場合は、経験豊富な方とマンツーマンで学習していくのもオススメです。

エポック数とは何か

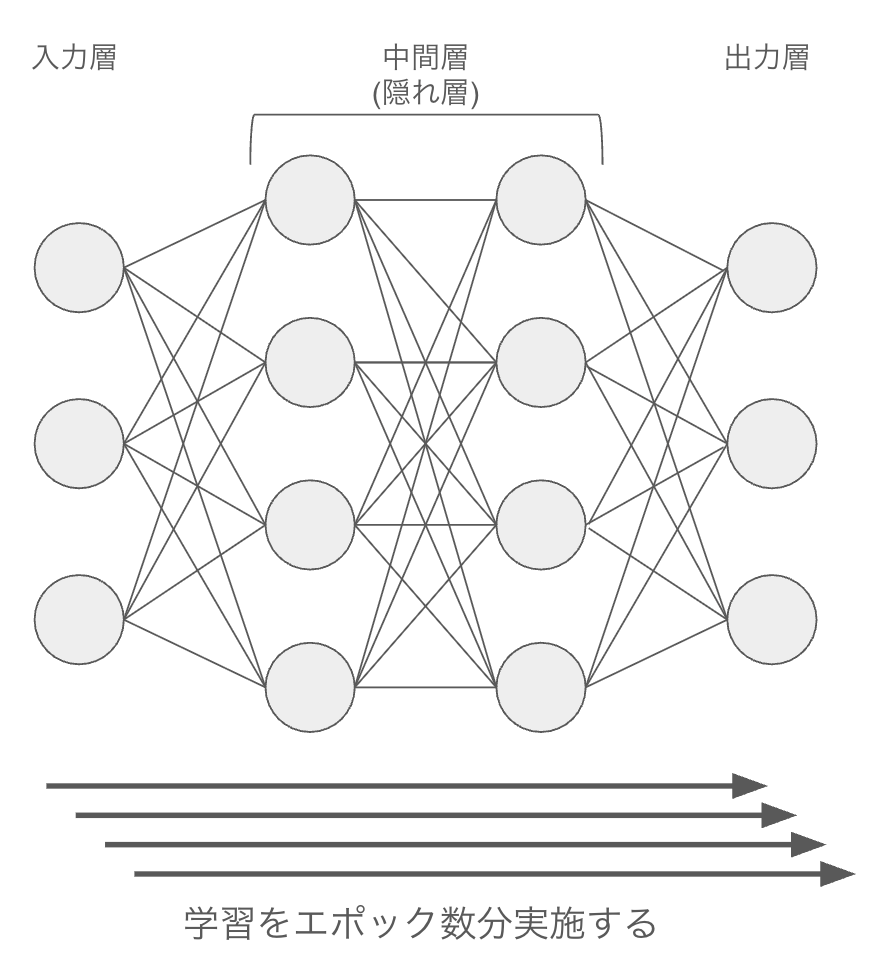

エポック数とは、ニューラルネットワークが全ての訓練データを一通り学習する回数を指します。1エポックは、モデルが訓練データセット全体を一度見て学習を完了することを意味します。

例えば、1000枚の画像データでモデルを訓練する場合、1エポックでモデルはこれら1000枚すべての画像を一度ずつ学習します。

エポック数を10に設定すれば、同じ1000枚の画像を10回繰り返し学習することになります。

エポック数が学習に与える影響

不十分なエポック数(学習不足)

エポック数が少なすぎる場合、モデルは十分にデータのパターンを学習できません。以下のようなシチュエーションが挙げられます。

- 訓練データ・検証データでの精度が低い

- 損失関数の値が高い状態のまま

過剰なエポック数(過学習)

一方で、エポック数が多すぎると「過学習(overfitting)」が発生します。これは、モデルが訓練データの細かなノイズまで学習してしまい、未知のデータに対する汎化性能が低下します。

- 訓練データでの精度は高いが、検証データでの精度が低い

- 訓練損失は減少し続けるが、検証損失が増加に転じる

最適なエポック数の設定方法

学習不足と過学習の対策として、下記の対策がよく実施されます。

- 早期停止(Early Stopping)

- 学習曲線の観察

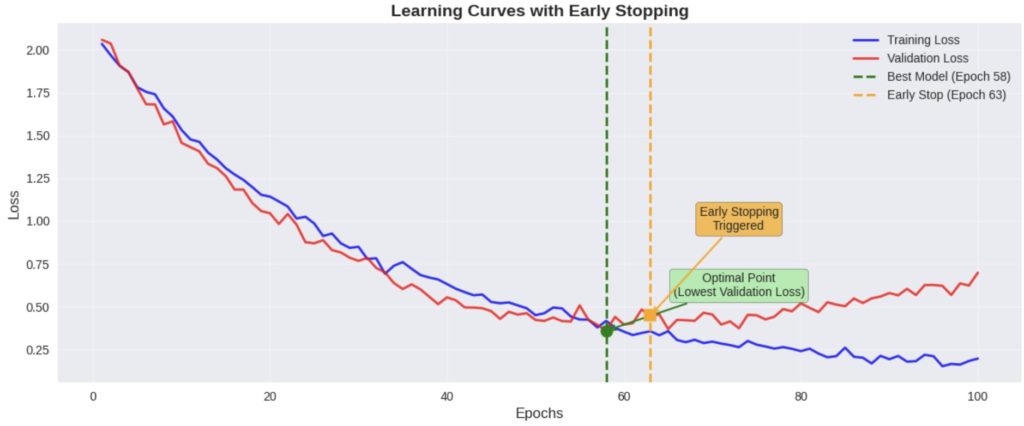

これらはどちらもエポック数を更新するごとに検証の損失を監視し、そのなかで最適なエポック数を監視するものになります。

下記のグラフ赤線(検証の損失:Validation Loss)が上がり始めたタイミングを監視することで最適なEpochを推察します。

この監視を実施しながら最適エポック数を判定する最も実用的な方法が早期停止(Early Stopping)です。これは、検証データでの性能が改善しなくなったタイミングで学習を自動的に停止する手法です。

実装のポイントとして

- 検証損失が連続して改善しない回数(patience)を設定

- 連続で改善しない回数(patience)に達した場合は、学習を終了する

上記のグラフではpatienceが5に設定されており、5回連続Validation Lossがその前より改善していないので、5つ前のエポック数をOptimal Pointとして設定しています。

まとめ

エポック数の設定は、機械学習プロジェクトの成功を左右する重要な要素です。

適切なエポック数は、データセットの特性、モデルの複雑さ、利用可能なリソースなど、多くの要因によって決まります。

重要なのは、固定的な値に頼るのではなく、早期停止などの動的な手法を活用し、学習曲線を注意深く観察することです。

深層学習を詳しく学びたい方にオススメの方法

書籍:ゼロから作るDeep Learning ―Pythonで学ぶディープラーニングの理論と実装

深層学習を学ぶと言ったらこの本、というほど分かりやすい初心者向けの書籍となります。エポックの意味や使い方を理解するためにはオススメの一冊です。

スクール:現役データサイエンティストに教えてもらう

ディープラーニングを構成する技術は様々な場面で活用されるため、網羅的に学習することがオススメです。

ただ、どのようにやるのが正しいのかを判断するには適切なメンターなどがいた方が安心です。スクールなどに入り、アドバイスしてもらいながら進めるのも良いでしょう。

コメント