はじめに

機械学習は近年急速に進化し、その応用範囲はますます広がっています。機械学習の手法を組み合わせ、モデルの性能を向上させるアプローチの一つが「アンサンブル学習」です。

本記事では、「機械学習 アンサンブル」に焦点を当て、その基本的な仕組みから実践的な活用法までを解説します。

この領域は複雑で理解が難しいですが、これらについて理解が難しい場合は、経験豊富な方とマンツーマンで学習していくのもオススメです。

アンサンブル学習の基本概念

アンサンブル学習は、複数の機械学習モデルを組み合わせて協力させ、個々のモデルよりも優れた性能を発揮させる手法です。これには主に以下の3つの手法があります。

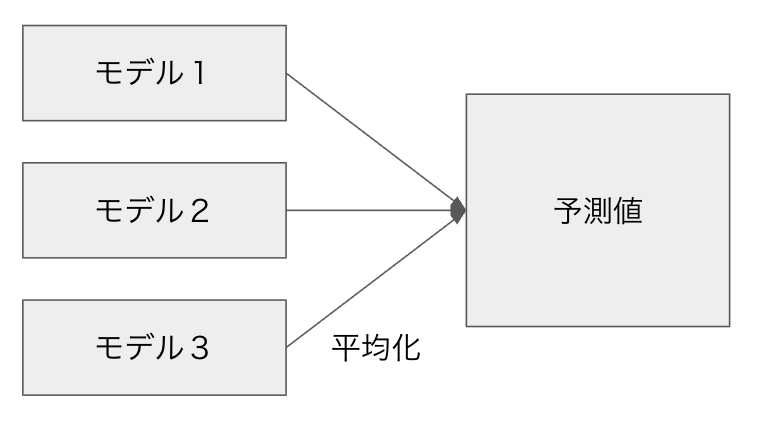

バギング(Bagging)

バギングは、ブートストラップサンプリングでデータをサンプリングし、それぞれのサンプルでモデルを訓練し、平均・多数決するような形で最終予測値する手法です。代表的なアルゴリズムとしてはランダムフォレストがあります。

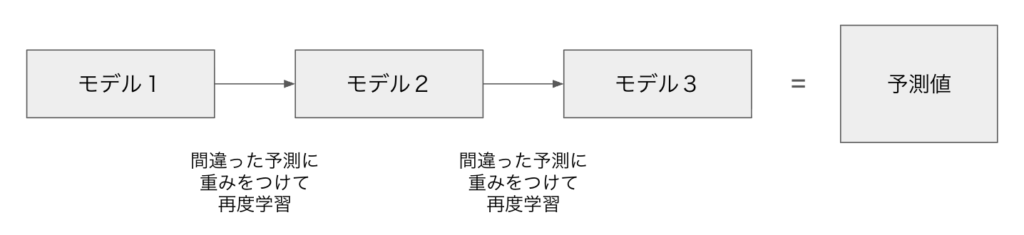

ブースティング(Boosting)

ブースティングは、前のモデルが誤った予測をしたデータに焦点を当て、その部分を修正していく手法です。代表的なアルゴリズムには、XGBoostやLightGBMがあります。

XGBoostなどは決定木がベース担っていますが、その決定木で予測をし、間違ったデータに対して重みをつけたデータにして再度学習するという過程を何度も行い予測をすることで、高精度な予測を実施します。

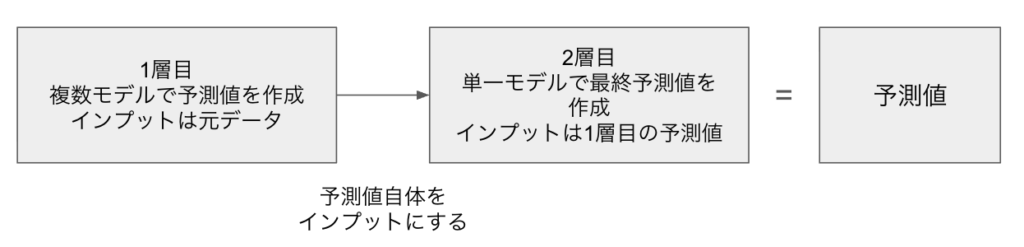

スタッキング(Stacking)

スタッキングは、異なる学習モデルを組み合わせて、それらの出力を入力として使い、最終的な予測をする手法です。複数のモデルを段階的に組み合わせて性能向上を図ります。

アンサンブル学習の利点

アンサンブル学習は、個々のモデルが抱える課題や限界を補完し合うことで、安定した予測性能を発揮します。

バイアスとバリアンスへの効率的な対応

単一のモデルではバイアスとバリアンスのトレードオフがありますが、アンサンブル学習はこのバランスを取り、安定かつ高い予測性能を実現します。

新規データセットに対する高い精度

アンサンブル学習は異なるデータセットに対しても柔軟に対応でき、汎化性能を向上させます。これにより、モデルの頑健性が向上します。

まとめ

機械学習の進展に伴い、アンサンブル学習はますます重要な位置を占めています。バギング、ブースティング、スタッキングといった手法を理解し、柔軟に組み合わせてモデルを構築することで、高い予測性能を実現できます。

プロジェクトにおいてアンサンブル学習を活用することで、モデルの信頼性と安定性を向上させ、より実用的な機械学習の適用が可能となります。

アンサンブルを学ぶ際にオススメの方法

書籍:Kaggleで勝つデータ分析の技術

言わずと知れたKaggle本ですが、こちらは精度向上手法について様々な観点から記載されています。そのため、アンサンブルだけに限らず特徴量の作り方など、幅広く学ぶことができます。

スクール:現役データサイエンティストに教えてもらう

ただ、どのように分析するかを判断するには適切なメンターなどがいた方が安心です。スクールなどに入り、アドバイスしてもらいながら進めるのも良いでしょう。

コメント